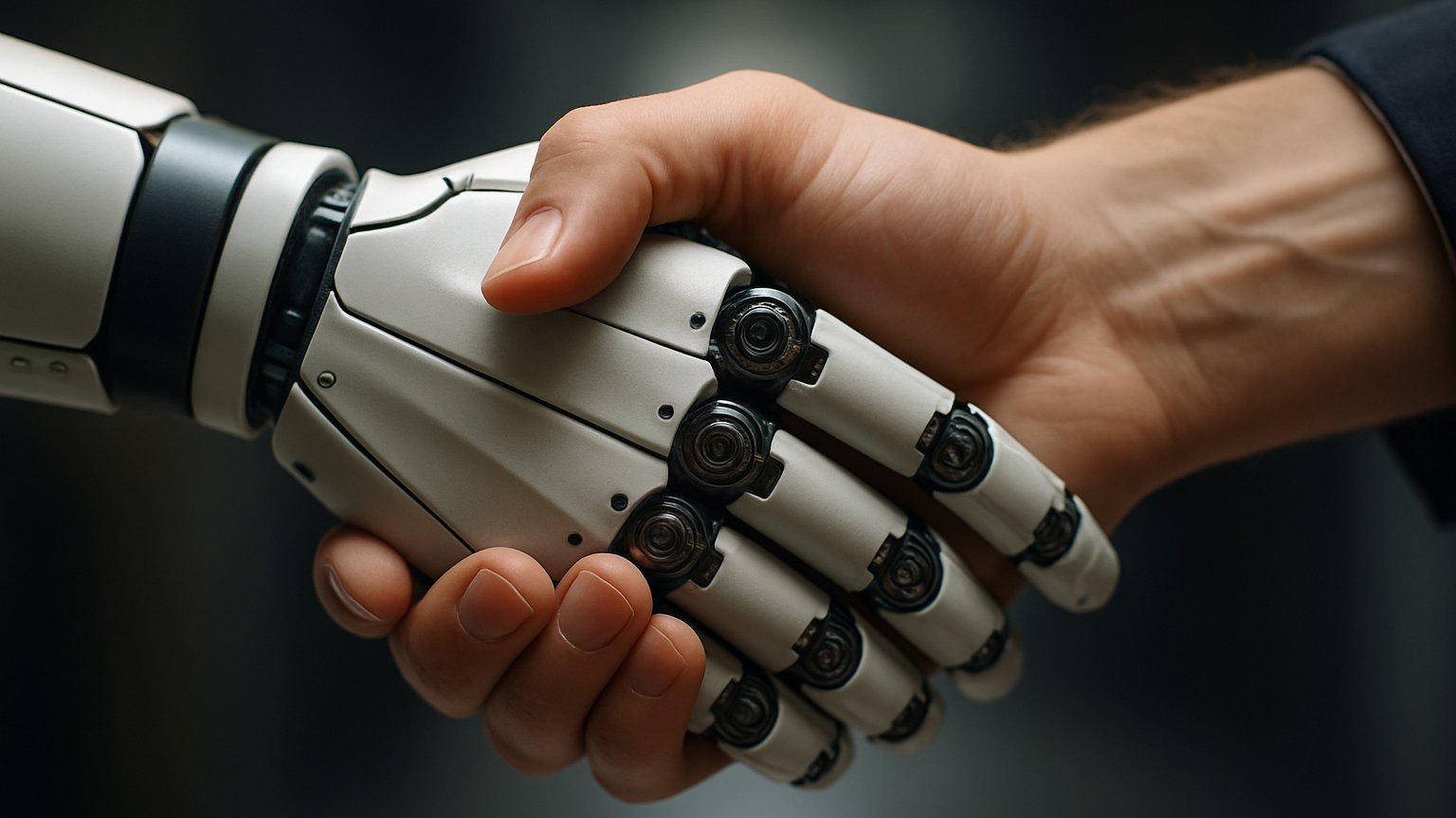

学びの限界を、AIとともに越えていこう。

AI共育応援団は、AIを学ぶ学生、そしてこれから学びたい学生を全力で応援します。 学びの楽しさと挑戦の勇気をAIとともに育み、限界を越えて未来へと踏み出す力を支えます。

学びの限界を、AIとともに越えていこう。

AI共育応援団は、AIを学ぶ学生、そしてこれから学びたい学生を全力で応援します。 学びの楽しさと挑戦の勇気をAIとともに育み、限界を越えて未来へと踏み出す力を支えます。

AIの偏見や情報漏洩などのリスクを踏まえ、理系学生が持つべき倫理・透明性・責任あるAI活用の重要性を解説。

“AIは中立で公平だから安心”と思っていないだろうか?

これは危険な誤解だ。AIは過去のデータを学習するため、社会に存在する偏見や差別をそのまま再現し、時には増幅してしまうことがある。

理系学生の君たちが将来、技術者・研究者・経営者として社会で活躍する時、

「AIを使えること」以上に「AIの限界と危険性を理解していること」が信頼の基盤になる。

AIの倫理問題は、技術だけでなく社会全体の課題だ。

そしてその解決策を考える責任は、AIを理解できる理系人材にこそある。

\\👉テックポータルへの会員登録は無料!応援・支援・特典を受けられる!あなた限定コンテンツも届きます//

\\👉まずは気軽にLINE友だち登録!今あなたに必要な情報を受け取ろう//

AIは「公平」ではない。時に、社会にある偏見をそのまま拡大してしまう。

代表的な事例が、Amazonの採用AI問題。

2014年、Amazonが採用業務を効率化するために開発したAIは、女性応募者を系統的に低く評価していたことが判明した。

過去10年の採用データを学習した結果、「男性が多く採用されてきた」という事実を“男性の方が優秀”と誤解してしまったのだ。

履歴書に「女子大学」や「女性バスケットボール部」といった単語があると、評価を下げる仕組みになっていた。

他にも、

理系学生が学ぶべき教訓は明確だ。

データは決して中立ではない。

AIを扱う人間が、データの背景や偏りを見抜く目を持つことが不可欠なのだ。

「便利だから」と使ったAIで、情報漏洩が起きた実例もある。

2023年、サムスン電子ではエンジニアがChatGPTに社内のソースコードを入力し、機密情報が漏洩。導入からわずか20日で3件の事故が発生した。

AIとの健全な関係の鍵は、「透明性」と「責任感」。

日本政府のAI事業者ガイドラインでも、透明性と説明責任(アカウンタビリティ)が重視されている。

最終的な責任は、AIではなく人間である君たちにある。

AIは道具。どう使うか、どこまで任せるかは君たち次第だ。

AIを使う場面では、「どこまでがOKか」の判断基準を持とう。

✅ OK:構成検討、表現の相談、誤字脱字のチェック

⚠️ 注意:内容の真偽確認、引用文献の確認

❌ NG:丸写し、架空引用、未実験データの記載

✅ OK:自己分析や想定質問の準備

⚠️ 注意:他人の経験の流用、美化しすぎた表現

❌ NG:虚偽の経験、AI生成文のコピペ

AI時代に求められるのは、単なる技術力ではない。

理系人材として社会に信頼されるためには、次の3つの力が欠かせない。

技術的理解力

AIの仕組みと限界を理解し、データの偏りを見抜く力。

倫理的判断力

公平性・人権・透明性を踏まえた意思決定をする力。

社会的責任感

技術の恩恵を社会全体で共有し、弱者にも配慮できる姿勢。

AIは強力な道具だが、万能ではない。

その限界を理解し、倫理的に使いこなせる人こそ、これからの社会で本当に信頼される存在だ。

理系学生の君たちには、技術を正しく理解し、社会の公正を支える力がある。

その力を、人間の尊厳と未来のために使おう。

技術は中立ではない。

それをどう使うかが、未来の社会を形づくる。

君たちは、どんな未来を創るだろうか?

テックポータルからあなた限定コンテンツへの招待が届きます。また、特典やイベントへの応募、気になる社会人に話を聞きにいくことができるようになります。また、気になる組織と「つながる」ことで組織からの最新情報もGET!

LINE公式アカウントを友だち追加しておくと、あなたの学年や状況に合わせて「今これだけ知っておけばOK」という情報が届きます。まずは気軽にLINE友だち登録!